El acuerdo voluntario supone que las siete compañías se comprometen a realizar pruebas internas y externas de sus sistemas de IA antes de hacerlos públicos, así como compartir información con otras empresas, Gobiernos, sociedad civil y el mundo académico sobre la gestión de los riesgos que supone la IA.

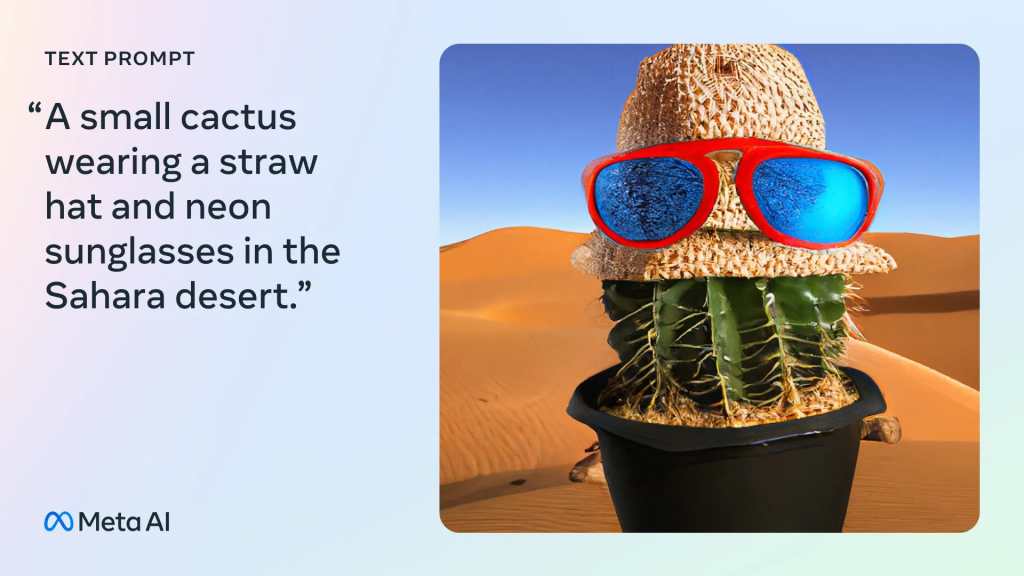

Además, las tecnológicas estadounidenses desarrollarán los sistemas de IA con la seguridad como prioridad y ofrecerán garantías al público con el etiquetado de los contenidos generados con IA, la investigación sobre los riesgos que supone para la sociedad y el desarrollo de sistemas que “ayuden a responder a los mayores desafíos” de la humanidad.

La Administración del presidente Joe Biden también dijo que está trabajando para que los compromisos voluntarios de las compañías estadounidenses se traduzcan en un “sólido marco internacional que gobierne el desarrollo y uso de la IA” y añadió que ya ha mantenido consultas con países como Brasil, Canadá, Corea del Sur, Francia, Alemania, India, Israel, Japón, México y el Reino Unido.

Desde que OpenAI lanzó al público el sistema ChatGPT, científicos, políticos y filósofos, así como organizaciones de defensa de los derechos humanos, han advertido de la amenaza que la IA puede suponer para la humanidad.

El martes 18 de julio, los países miembros del Consejo de Seguridad de la ONU destacaron los peligros de una aplicación militar de la inteligencia artificial.

En este sentido, el secretario general de la ONU, António Guterres, reiteró que el futuro desarrollo de la inteligencia artificial (IA) debe estar “gobernado” por una entidad dependiente de Naciones Unidas.